MIT memperkenalkan pendekatan baru untuk melatih robot

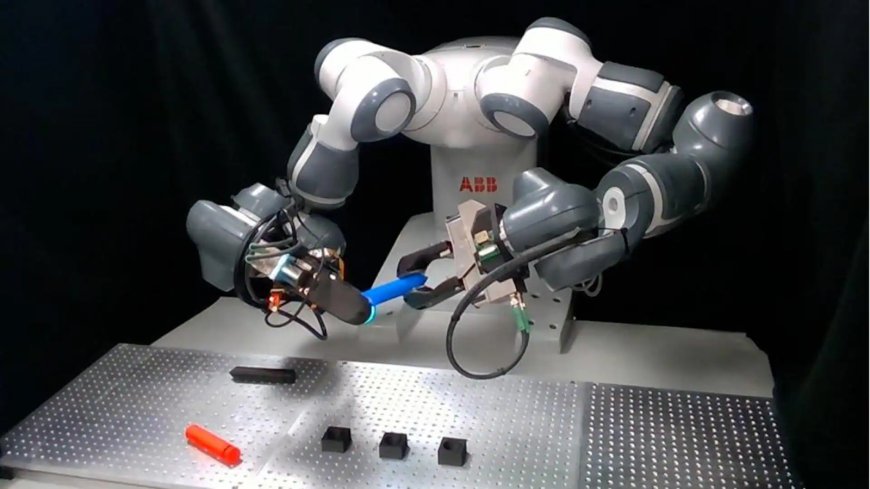

Model HPT MIT diambil dari berbagai sumber data, meningkatkan kemampuan beradaptasi robot di lingkungan yang tidak dapat diprediksi.

Model HPT MIT diambil dari berbagai sumber data, meningkatkan kemampuan beradaptasi robot di lingkungan yang tidak dapat diprediksi.

MIT telah meluncurkan metode baru untuk melatih robot yang meningkatkan skala data dengan cara yang mirip dengan model bahasa besar (LLM), yang menandai peralihan dari kumpulan data yang sempit dan berfokus pada tugas yang secara tradisional digunakan dalam robotika. Pembelajaran imitasi, di mana robot belajar dengan mengamati manusia, sering kali kesulitan dengan variabel baru seperti perubahan pencahayaan atau rintangan yang tidak terduga. Dengan mengadopsi pendekatan data yang luas yang mirip dengan yang digunakan dalam model seperti GPT-4 , para peneliti MIT bertujuan untuk membantu robot beradaptasi lebih fleksibel dalam berbagai lingkungan.

Tim mengembangkan arsitektur baru yang disebut Heterogeneous Pretrained Transformers (HPT), yang menggabungkan informasi dari beberapa sensor dan berbagai pengaturan untuk membangun model pelatihan yang tangguh. Transformer yang lebih besar menghasilkan hasil yang lebih baik, sejalan dengan tren yang terlihat di LLM, karena HPT mengintegrasikan data dari berbagai sumber untuk respons robot yang lebih adaptif.

Pada akhirnya, para peneliti bercita-cita untuk menciptakan 'otak robot' universal yang dapat diunduh dan digunakan segera tanpa pelatihan tambahan. Meskipun masih dalam tahap awal, proyek ini mendapat dukungan dari Toyota Research Institute, yang baru-baru ini bermitra dengan Boston Dynamics untuk mengintegrasikan penelitian pembelajaran dengan perangkat keras robotik canggih.

What's Your Reaction?